Adobe chce, aby sa AI obrázky dali špeciálne označiť

Tvorba obrázkov a videa umelou inteligenciou by mohlo byť v budúcnosti rozpoznateľné.

Tentoraz nejde o žiadnu štátnu reguláciu, alebo zásah do vlastníckych práv. Práve naopak. Iniciatíva, v ktorej zohráva hlavnú úlohu firma Adobe chce, aby boli jasne rozlíšené obrázky alebo video, ktoré bolo spracované umelou inteligenciou. Táto značka by nemala niesť informáciu o tom, že video je podvrh alebo hoax. Ide o to, aby bolo na pohľad a aj s dôrazom na vyhľadávanie v metadátach definované autorstvo daného obrázku alebo videa.

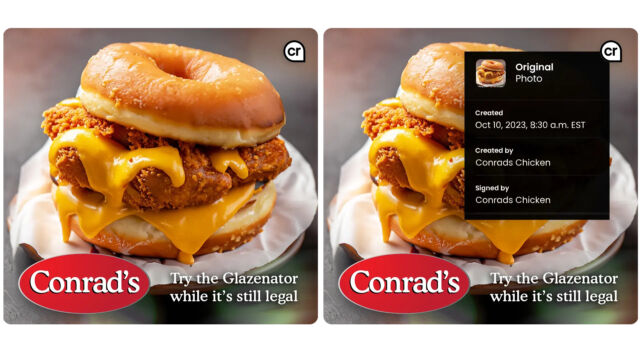

Microsoft Bing označuje svoje obrázky vlastnou ikonou a ide o polopriehľadný znak, ktorý je vložený ku každému generovanému obrázku. Nová ikona, ktorá bude obsahovať písmená Cr, má byť symbolom pre Credentials, čo znamená „poverenie“. V rámci spomínanej koaličnej skupiny, ktorá sa nazýva Coalition for Content Provenance and Authenticity (C2PA) ide o spoluprácu viacerých firiem, ako sú napríklad BBC, Microsoft, Nikon alebo Truepic.

V minulosti sme sa venovali tejto téme a digitálny obrázok by mal niesť informáciu o tom, že bol vytvorený za pomocou AI tak, aby sa táto informácia nedala odstrániť. Nateraz to vyzerá tak, že logo, ktoré bude pridané do takéhoto obsahu, bude obsahovať súbor ďalších informácií. Budú digitálne podpísané a vydavateľ sa bude dať dôveryhodne overiť, či už priamo aplikáciou, ktoré tieto funkcie implementujú, alebo inými aplikáciami vytvorenými na tento účel.

Novú iniciatívu o transparentnosti, ktorú chce Adobe v spolupráci s koalíciou priniesť, však podľa odborníka Marka Wilsona z Fast Company, čakajú výzvy. Logo nemusí znamenať, že médium obsahuje autentické metadáta. To, čo budú tieto metadáta, obsahovať a čo v skutočnosti označuje je, že obrázok bude mať časovú značku v deň, kedy bol určitým softvérom vytvorený.

Podľa jeho hodnotenia by takéto potvrdenia pokojne mohli mať aj videá deepfakes, obrázky CGI alebo zavádzajúce a nepravdivé fotografie. To na čo upozorňujeme, je fakt, že používateľ bude mať informáciu o tom, že obrázok bol nejakým spôsobom upravovaný za pomoci AI. Jeho pravdivosť si však stále budeme musieť overiť iným spôsobom.

Máme tu opačný prípad a to vtedy, keď bude obrázok pravdivý, no bude obsahovať mierne úpravy kvôli zacieleniu výpovednej hodnoty. To sa môže stať napríklad vtedy, ak tvorca fotografie bude chcieť z obrázku odstrániť nepodstatné alebo nerelevantné údaje a nechce ich urobiť orezaním obrázka. Použije AI a hoci obrázok bude autentický, bude musieť obsahovať túto značku, aby bolo jasné, že obrázok bol upravovaný. Je to deepfake? Nie.

Ďalšou otázkou bude povinnosť uvádzať takýto znak v obrázku a prítomnosť potrebných metadát. Zatiaľ to vyzerá tak, že neexistuje spôsob, ako donútiť tvorcov obrázky označovať. Je zrejmé a že ak budú využívať niektorý z dostupných nástrojov vo forme online a renomovaných editorov fotografií, nebudú mať na výber a tieto vodoznaky budú vkladané automaticky. Stačí však, aby použili nástroj, ktorý nevnucuje takýto vodoznak a hoaxy a iné podvrhy sa môžu šíriť aj naďalej. Tu už ale nastáva otázka toho, ako budú používatelia veriť týmto obrázkom, keďže sa vyhýbajú označeniu príslušným vodoznakom.

Zdroj: ArsTechnica

Prečítajte si aj:

Podobné články

ChatGPT 5.3 Instant je dostupný aj na Slovensku

EVOLVEO BoneMax: Slúchadlá, ktoré nechávajú vaše uši otvorené

NotebookLM má 10 nových štýlov na infografiku

TOP 10 najobľúbenejších filmov na internete 2026 – 9. týždeň

Claude AI vám pomôže opustiť ChatGPT