Aktuálne sa termín deepfake najviac používa v súvislosti s falošnými videami.

Najčastejšie ide o videá, kde celebrita, politik, či iná známa osobnosť hovorí niečo, čo nie je pravda. Takisto sa do tejto kategórie zaraďuje aj video s obsahom, ktorý neodpovedá skutočnosti a ide o zámerný podvrh – napríklad video s katastrofou, ktorá neodpovedá realite.

Čo je to deepfake?

Toto slovo znázorňuje spojenie hlbokého neurálneho učenia ako deep learning a falošného obsahu. Akonáhle hovoríme o audio podobe, máme na mysli skôr face swaping (zámena tváre) alebo voice cloning (klonovanie hlasu).

Rozpoznať takéto video alebo napodobneninu hlasu bolo v minulosti podstatne jednoduchšie. Nehovoriac o tom, že s technológiami starými 10 a viac rokov bolo problematické až nereálne vytvorenie falošného obsahu vo forme videa.

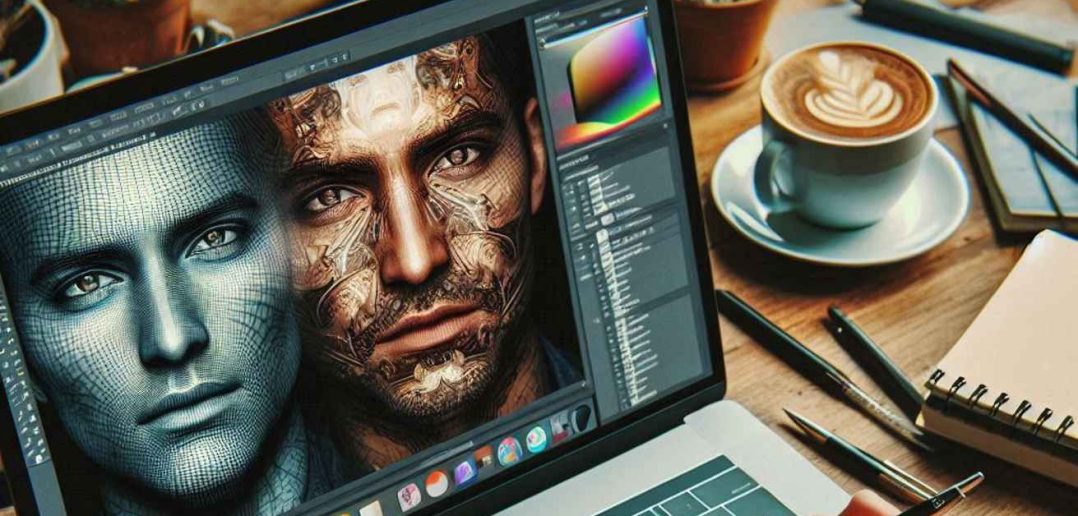

Dnes, aj vďaka masívnemu rozšíreniu technológií s umelou inteligenciou a najmä výpočtovému výkonu, dokážete generovať falošné videá na počkanie. Je to skutočne tak a nepotrebujete byť ani expert v oblasti počítačovej grafiky a animácie. Nástroje ako OpenAI Sora či Runway vytvoria falošné video len prostredníctvom 1 či 2 fotografií, aby zaznamenalo protagonistu z viacerých uhlov a dokázalo vytvoriť realistický model.

Prečo vznikajú deepfake videá?

Súčasťou politického boja a hybridných hrozieb, o ktorých dnes počúvame, je aj zapojenie AI do problematiky falošného video snímkovania. Na internete a špecificky na sociálnych sieťach sa objavujú videá, kde prezident konkrétnej krajiny hovorí niečo, čo nie je pravda. Zneužívajú sa rôzni predstavitelia, a to nielen v politike.

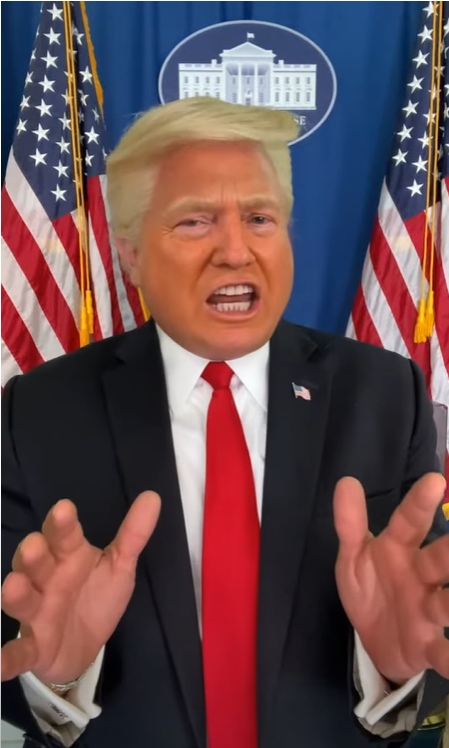

V roku 2018 politická strana v Belgicku zverejnila video s vtedajším americkým prezidentom Donaldom Trumpom, ktorý vyzýval Belgicko na odstúpenie od Parížskej klimatickej dohody. V skutočnosti ale americký prezident tento prejav nepovedal a išlo o falošné video z kategórie deepfake.

Bežne sa na sociálnych sieťach stretávame s vyjadreniami od celebrít k rôznym, a to nielen politickým témam. Neraz sú takéto videá vytvárané ako vtipy či nenásilná zábava. Opačnou stránkou sú videá, ktoré sú vytvárané s cieľom oklamať obecenstvo a poškodiť ľudí. Typicky nemusí ísť len o politické vyhlásenia, pretože tie na bežných ľudí nemusia mať taký priamy dosah, ako napríklad odporúčanie niekam investovať od známej osobnosti.

Pomsta a zosmiešňovanie

Technológia, ktorá môže prinášať vtipné videá, býva zneužitá a aj v roku 2025 je predpoklad nárastu falošného obsahu. To je odvrátená stránka a práve preto púta na seba takú veľkú pozornosť. Vidieť pápeža v páperovej bunde je úsmevné a je veľmi pravdepodobné, že sa na takomto obrázku pobaví aj on sám. Išlo o fotografiu vygenerovanú umelou inteligenciou, ktorú nepovažujeme priamo za deepfake v zmysle, v akom sa o ňom teraz rozprávame.

Dnešné algoritmy však vedia práve z takejto fotografie vytvoriť skutočne pohybujúceho sa pápeža, ktorý kráča po námestí v tejto bunde. Nepríjemné je, že v posledných mesiacoch vznikajú čoraz viac zosmiešňujúce videá z dôvodu pomsty. Či už ide o snahu zosmiešniť verejne známu osobnosť alebo sa pomstiť niekomu z bývalého vzťahu. Nahé fotografie alebo videá vygenerované na základe predlohy oblečenej osoby nie sú ničím výnimočné.

Ako odhaliť deepfake?

Tak ako existujú nástroje na vytvorenie falošného obsahu, už dnes sú k dispozícii mechanizmy na jeho odhaľovanie. V prípade obrázkov sa do takejto iniciatívy zapojilo viacero spoločností, a to najmä z kreatívneho priemyslu.

Ide napríklad o výrobcov softvéru a algoritmov, ktoré dokážu vytvárať takýto typ obsahu. Nehovoríme o tom, že obsah vygenerovaný umelou inteligenciou je škodlivý. Ide len o to, aby používatelia boli informovaní, že vo videu sú použité takéto prvky.

Do iniciatívy sa zapojil aj server YouTube, ktorý musí teraz obsahovať informáciu priamo od tvorcu, že video obsahuje prvky vygenerované AI. Nie je to vždy potrebné a deje sa to na základe pravidiel. Typicky ide o obsah, ktorý obsahuje miesta zo skutočného života no neodpovedajúce realite.

Tiež aj osoby vykonávajúce na videu činnosť, ktorú ale nevykonávali v skutočnosti. Platí to aj pre generovanie zvuku, ktorý sa v danej scéne pripomínajúcej realitu neudial, napríklad výbuch v lokalite, ktorá skutočne existuje, no výbuch tam nenastal. Ak by ste na Sochu slobody aplikovali AI generovanie požiaru, takéto video musí byť označené, že ide o umelecké stvárnenie za pomoci AI nástrojov.

Zdroj: Terragen

Zdroj: TerragenFalošné obrázky a videá

Podobne ako pri obrázkoch, to platí aj pri videu a už dnes existuje detekčná platforma od firmy Sensity na odhaľovanie deepfakes. Otázkou teraz je, ako sa s tým dokážu vysporiadať používatelia, ktorí nemajú k dispozícii takéto nástroje.

Napríklad novinári, ktorí môžu pri hľadaní zdroja naraziť na obsah tohto typu. Ukázalo sa, že najefektívnejším spôsobom, ako odhaliť falošné obrázky, je pokúsiť sa nájsť ich pôvod prostredníctvom vyhľadávača obrázkov. Využiť sa na to dá Google.

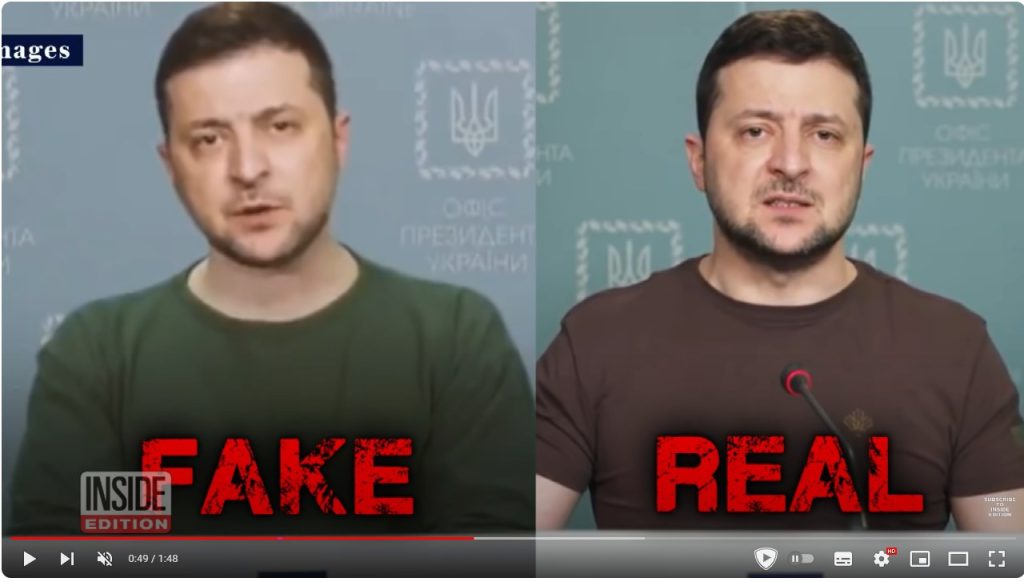

Aktuálne ešte žijeme v dobe, keď nás deepfake nedokáže naplno presvedčiť a dokážeme ho odhaliť takpovediac voľným okom. Na to je potrebné viac pozornosti a nesústrediť sa len na kvalitu príspevku. V minulosti platilo, že ak bola tvár alebo video príliš rozmazané, prípadne v niektorých častiach horšie čitateľné, išlo o podvod. Rozmazanie alebo nekvalita grafického stvárnenia v určitých sekvenciách boli zapríčinené nedokonalou animáciou a potrebou to zakryť.

Zdroj: Inside Edition

Zdroj: Inside EditionVšímajte si telo a pery

Naplno sa však nedá spoliehať na to, že na základe kvality odhalíte falošné video. Väčšina ľudí si pozerá obsah na malých 6,5“ displejoch svojich smartfónov. Sústreďte sa preto nielen na pohyb tváre a mimiku, ale aj na pozadie. Neraz odhalíte, že osoby vygenerované na takýchto videách majú neprirodzene skrivené prsty alebo nevhodne ohnuté kĺby končatín (tzv. Full Body Pupperty, manipulácia s telom).

Zatiaľ sú stále ústa a pery (technológia Lip-syncing) najdôležitejším rozpoznávacím prvkom. Aj napriek pokročilej synchronizácii modelovacích nástrojov s hovoreným slovom, sú tieto znaky ľahko rozpoznateľné, no treba sa viac zapozerať. Chyby si môžete všimnúť aj na neprirodzenom žmurkaní.

Podľa informácií od odborníkov z rôznych univerzít stále platí, že snahy na potlačenie deepfake videí nie sú dostatočné. Viac ako na samotné mechanizmy, ktoré by dokázali automatizovane odhaliť falošný obsah, bude potrebné sa sústrediť na vzdelávanie a informovanosť samotných používateľov.

Nástroje na odhalenie deepfake

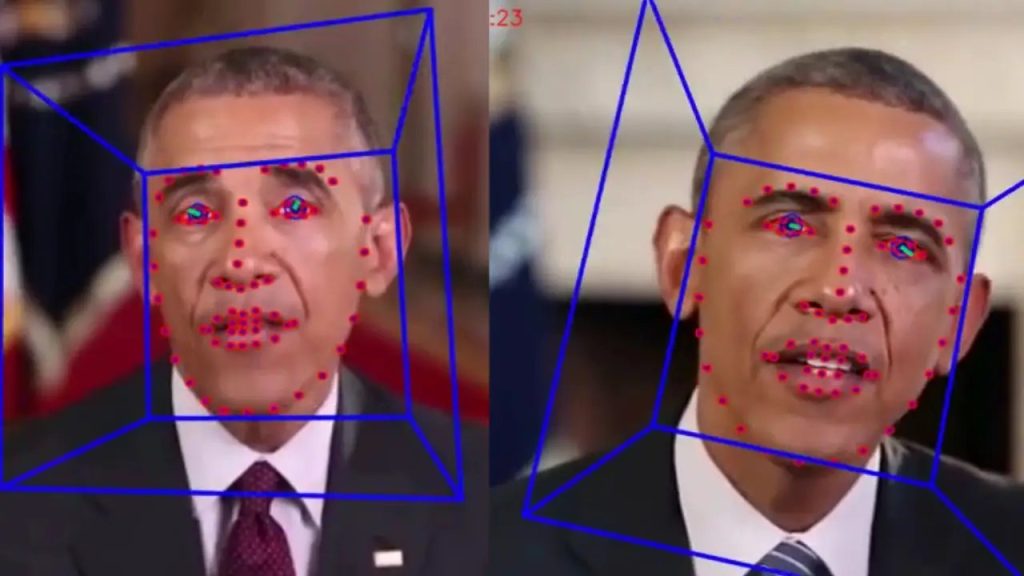

Dnes sa z pohľadu automatizovanej činnosti môžeme spoľahnúť na takzvané digitálne odtlačky a porovnávanie videí. Deepfake z videa totiž vznikajú väčšinou na základe istej predlohy s výmenou tvárí respondentov.

Ak už niektoré video bolo automatizovaným mechanizmom nájdené a označené ako skutočné, je jednoduchšie porovnať novovzniknuté videá s odlišnosťami v obraze. Medzi takéto nástroje patria napríklad Sentinel, Attestiv.Video alebo WeVerify.

Na Slovensku a vo svete

Videá zahraničných politikov a hercov ste už možno videli. Slovensko nie je výnimkou a podvody s deepfake sa dejú aj u nás. V prípade moderátorky TV Markíza však išlo o cielenú informačnú kampaň, ktorá mala upozorniť používateľov na tieto podvody. Pozrite si video vyššie, kde sa dozviete viac a aj to, ako reálne pôsobí.

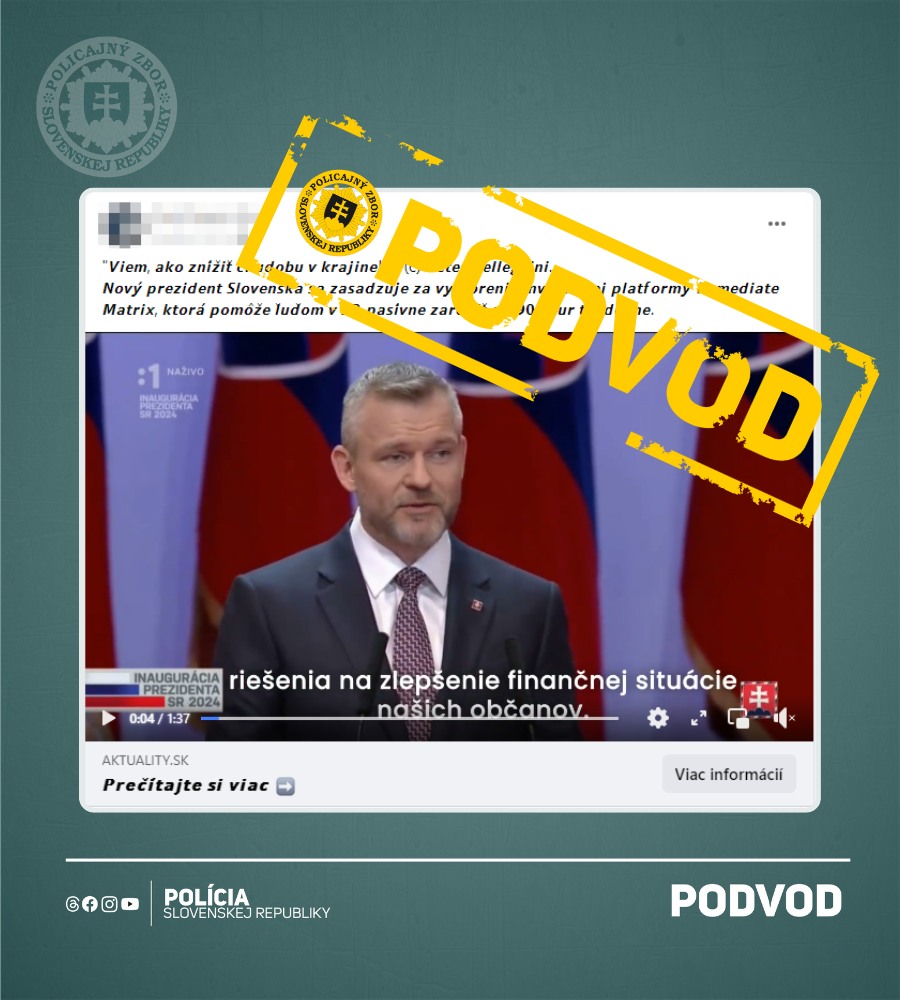

Popri zahraničných prezidentoch krajín nie je výnimkou ani slovenská politická scéna. V roku 2022 sa objavilo video, kde sa Peter Pellegrini objavil vo videu lákajúcom na investície. Upozornenie voči podobným praktikám vydala aj Národná banka Slovenska.

Zdroj: FB Polícia Slovenskej Republiky

Zdroj: FB Polícia Slovenskej RepublikyPrečítajte si aj: