Umelá inteligencia pri preťažení dáva stručnejšie odpovede

Niektoré nástroje chcú zachovať rýchlosť na úkor rozsiahlosti.

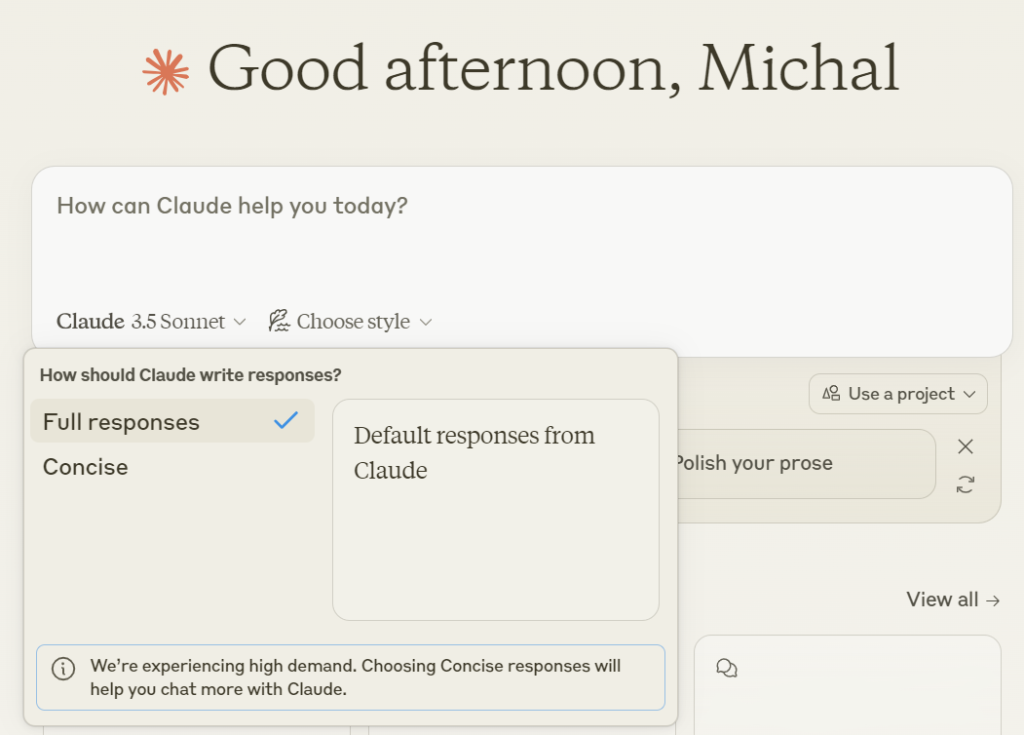

To nemusí byť pravidlom pre všetky LLM a spravidla sa stretnete s dvomi prípadmi. Buď bude AI reagovať pomalšie alebo poskytne menší objem vygenerovaného textu. Príkladom informovaného skrátenia výstupov je LLM model od Anthropicu používaného v Claude AI. Najvýkonnejší model Sonnet 3.5 má po novom dve možnosti.

Základnou je fungovanie v plnom rozsahu, druhá je Concise teda stručnejšia odpoveď. Pred samotným prepnutím dostanete upozornenie o tom, že server zaznamenáva veľký nápor dopytov a odporúča sa použiť model s generovaním stručnejších odpovedí. Niekedy sa stane, že sa automaticky prepne na režim Consice.

Nejde o nič tragické, len si treba dať na to pozor. Pri veľkom zaťažení môže ísť o vhodnú možnosť, ako dostať odpoveď s minimom zníženého komfortu pri používaní. Nie vždy potrebujeme siahodlhé odpovede. Navyše LLM nástroje generujú texty v odrážkach a ich primárnou odpoveďou je dávanie sumáru. Jednotlivé body sa dajú rozviesť detailnejšie po novom dopyte.

Zdroj: vlastné

Prečítajte si aj:

Podobné články

Najlepšie seriály na Netflixe 2026 (13. týždeň)

Prvá jazda s BMW iX3 50 xDrive: Ticho, výkon a nový smer

Superpočítač PERUN bol spustený do ostrej prevádzky